Parece que no pasa un mes sin sobresaltos por un nuevo modelo de IA generativa. El 21 de marzo, Suno lanzaba su versión 3, generando gran interés y preocupación en la industria de la música en poco tiempo. Udio, recién estrenado y con problemas para atender la alta demanda de usuarios, parece que va a dejar atrás a la competencia.

Relacionado: Artistas musicales reaccionan a la IA: «Stop devaluing music»

This is wild.

— Min Choi (@minchoi) April 10, 2024

Udio just dropped and it's like Sora for music.

The music are insane quality, 100% AI. 🤯

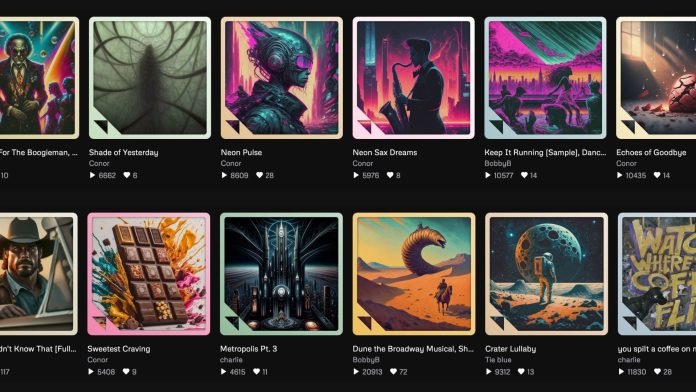

1. "Dune the Broadway Musical" pic.twitter.com/hzt7j32jIV

Fragmentos cortos y mayor control

Como en otras herramientas de IA generativa, para producir una canción es suficiente con escribir un prompt descriptivo de lo que se desea. En las instrucciones de uso de la plataforma, Udio declara que no utilizan voces de artistas concretos, pero pueden escribirse sus nombres para referenciar su estilo. La plataforma reemplaza el nombre por etiquetas descriptivas relevantes, como Suno. En lugar de «Elvis Presley», por ejemplo, «50s rock, hero theme, male vocals».

Una opción que no ofrece Udio es la de imitar el estilo de otro track, o crear un sonido basándose en otro, como sí lo hace Stable Audio.

Permite añadir letras propias, con detalles como qué parte es el estribillo, o si algo debe ser cantado por voces de acompañamiento. Una vez generado un fragmento, es posible añadirle otros, como una intro u outro, así como fragmentos anteriores y posteriores para alargar el track. Por defecto, en origen son más breves que los de Suno. Así, si se desea, el contenido generado puede tener inicio, desarrollo y cierre.

Mejor calidad que otros modelos

No obstante, las funcionalidades no son lo que sorprende, sino la calidad. Los tracks superan las expectativas de los usuarios y suenan mejor que los generados por Suno v3, que ya sorprendía. Udio produce menos artefactos, exporta en estéreo y aprovecha ambos canales de forma independiente.

Algunos expertos comentan que voces e instrumentos se «funden» de forma más orgánica que en Suno.

Relacionado: La IA pone en peligro el 27% de los ingresos de los creadores musicales

Incidencia en los derechos de propiedad intelectual

Al igual que sucede con el resto de inteligencias artificiales generativas, surgen dudas significativas respecto a los contenidos utilizados para entrenar este tipo de sistemas.

Google Deepmind, desarrolladora de Udio, no se ha pronunciado al respecto. Aunque se puede llegar a entender que, al igual que sus competidores, pueden estar utilizando grandes cantidades de contenidos protegidos por derechos de autor y propiedad intelectual como inputs para alimentar su sistema.

Demandas como la de The New York Times contra OpenAI y Microsoft, o la de Getty Images contra Stable Difussion han supuesto el inicio de una batalla legal entre empresas titulares de derechos y desarrolladoras de sistemas de IA generativa.

Relacionado: NYT revela malas prácticas de las tecnológicas para entrenar IA

Lo que sí han anunciado los desarrolladores es que Udio cuenta con un sistema que le permite identificar y bloquear las pistas generadas que sean demasiado similares al trabajo de determinados artistas, lo que va dirigido a conseguir que la música generada por el sistema sea original.

Esto podría, hasta cierto punto, solventar problemas respecto de las canciones expedidas por el sistema. Impediría que los outputs plagien obras ya existentes. Sin embargo, la principal fuente de conflictos reside en el uso de ciertos contenidos preexistentes como inputs, y este asunto sigue siendo incierto.

Tendremos que esperar a las primeras resoluciones judiciales sobre este asunto para saber si existe una verdadera infracción de derechos por parte de Google Deepmind y el resto de empresas desarrolladoras de estos sistemas.

Fuente: Theoretically Media, Wired